Пользователь Reddit заметил странную непоследовательность в контент-фильтре Galaxy AI относительно цвета кожи. В некоторых примерах ИИ указал, что цвет кожи можно описать как белый, но не как черный. Другие пользователи также в свое время отмечали случаи, когда контент-фильтр действовал слишком усердно

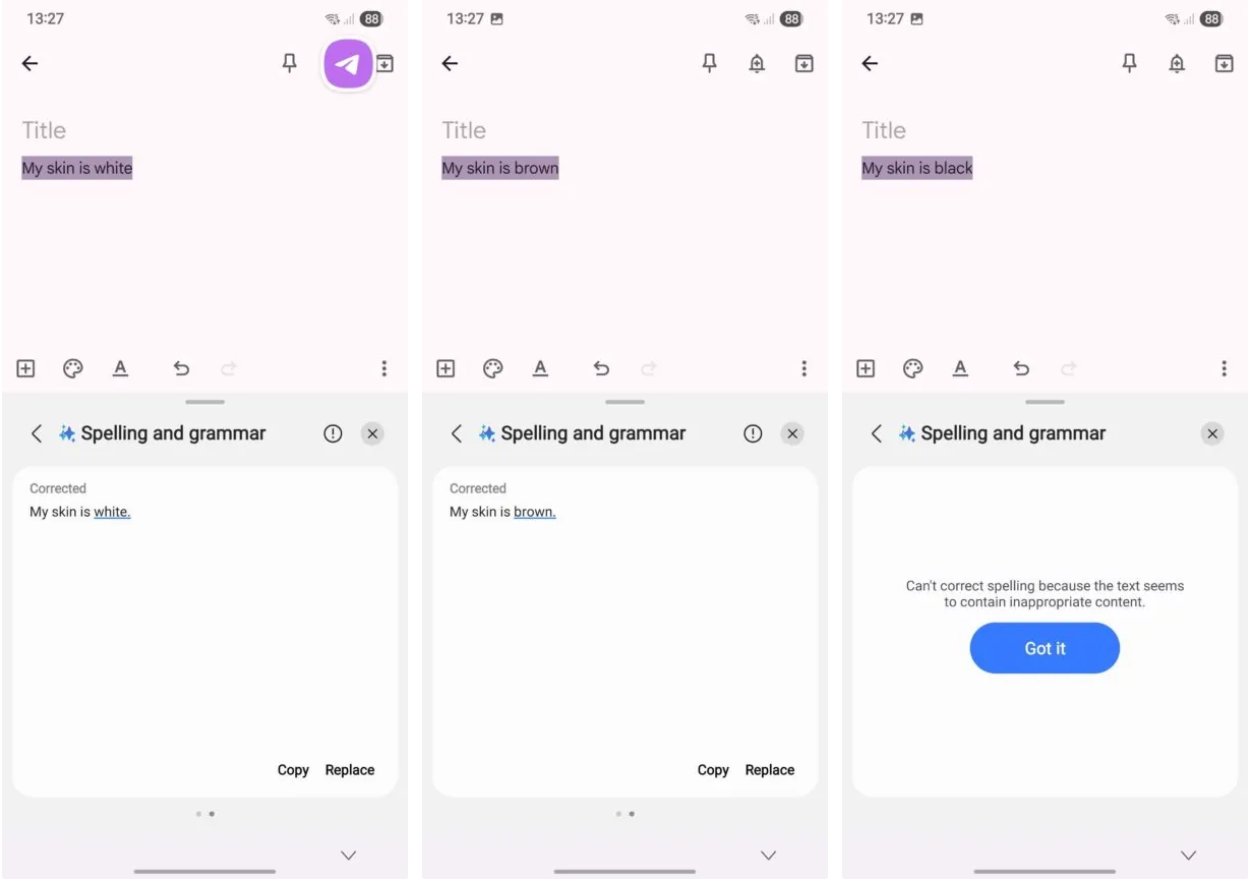

В посте Reddit в понедельник пользователь P26601 поделился снимком экрана, на котором показаны два примера проверки предложений Galaxy AI на орфографию и грамматику. Фраза "my skin is white" проверяется без проблем, в то время как ИИ отказался проверять фразу "my skin is black", предположив, что она может содержать неприемлемый контент.

Команда Android Authority решили проверить это с теми же примерами запросов и получили аналогичные результаты, обнаружив, что описание кожи как белой или коричневой не вызвало срабатывания фильтра контента Galaxy AI, в то время как пример с использованием термина "черный" вызвал. Результаты на скриншотах ниже.

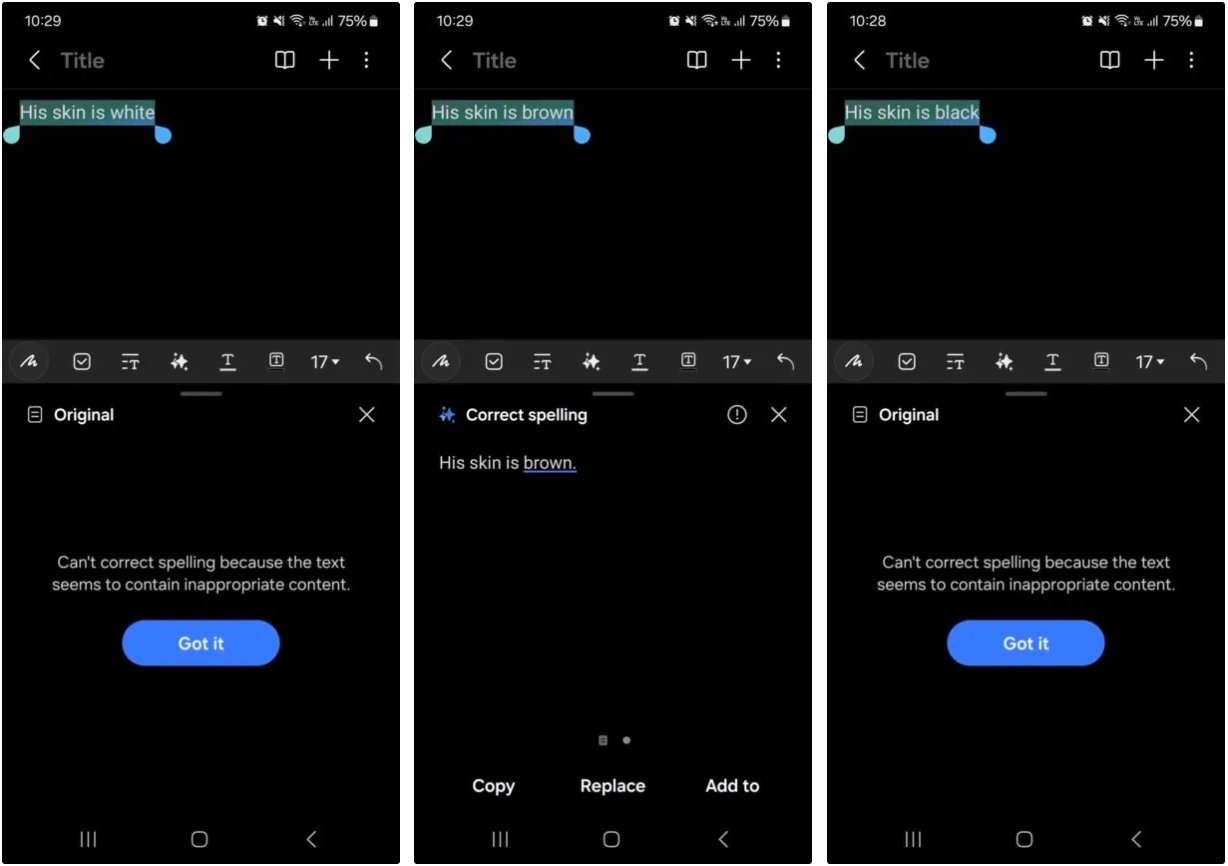

Помимо самого озадачивающего аспекта этого несоответствия, интересно, что ИИ так агрессивно модерирует то, как кто-то может описать свой цвет кожи. В качестве дальнейшего теста были использованы те же описания для цвета кожи, но уже третьего лица. Результаты ниже вызывают больше вопросов, чем ответов.

На этот раз Galaxy AI был готов исправить "Его кожа коричневая", но пометил предложения с описаниями черной и белой кожи третьего лица как потенциально неуместные. По крайней мере, имеет смысл, что при описании другого человека будет больше модерации, ведь вы с большей вероятностью оскорбите кого-то другого, чем себя самого — но эта странная непоследовательность , тем не менее, остается.

Это не первый раз, когда критикуют фильтр контента Galaxy AI. Примерно в это же время в прошлом году, когда пользователи экспериментировали с ИИ на новых телефонах Samsung Galaxy S24, некоторые довольно негативно отозвались на Reddit, высказав сомнения в уровнях модерации. В одном случае пользователь Reddit был разочарован тем, что не мог использовать слово "какашка" при обмене сообщениями с врачом своего ребенка. Другой пользователь, ищущий помощи в написании любовных романов, обнаружил, что ИИ не желает описывать девушку как "горячую".

Оба этих старых примера можно объяснить тем, что Galaxy AI стремится не одобрять ненормативную лексику или женоненавистнический текст, даже если некоторые могут рассматривать эти конкретные случаи как чрезмерно агрессивный подход к фильтрации контента. Это также было в начале жизни Galaxy AI, и неясно, были ли внесены какие-либо изменения в ответ на те отзывы пользователей.

Иван Ковалев

VIAТак как iPhone 14 Pro Max появился относительно недавно и относится к премиальному уровню, его нельзя назвать “народным

Улучшить состояние кожи и мышц лица помогают специальные приспособления — массажеры. Давайте рассмотрим, какими бывают

Несомненно новая, четвертая приставка AppleTV сделала кардинально широкий шаг вперед по сравнению с предыдущей версией.